Grote taalmodellen zijn inmiddels bij veel mensen ingeburgerd geraakt, maar hun rol blijft vaak beperkt tot het voeren van gesprekken. AI-agents gaan een stapje verder en kunnen ook autonoom handelen. Aan de basis liggen de vertrouwde grote taalmodellen, die echter beschikken over tools die ze kunnen inzetten. Afgelopen jaar zijn AI-agents heel wat krachtiger geworden, maar ze hebben ook duidelijke beperkingen.

Een groot taalmodel alleen heeft vele beperkingen. Zo is de kennis gelimiteerd tot de teksten waarop het model is getraind. Wanneer je aan het model vraagt wat voor weer het morgen wordt, kan het daar niet op antwoorden, of het verzint iets. Maar ook wanneer je vragen stelt over je eigen teksten, moet je het taalmodel eerst die teksten laten zien. Het draait allemaal om extra context.

Al vrij snel zijn daar oplossingen voor ontwikkeld, in de vorm van RAG (retrieval-augmented generation), tools en function calling. Met RAG geef je een taalmodel toegang tot nieuwe, specifieke informatie. Met tools of function calling stel je een taalmodel in staat om externe programma’s aan te roepen. Dat kan zijn om gegevens uit een database te halen, het weerbericht op te vragen of een rekenmachine te gebruiken, maar ook om online een hotelkamer te reserveren.

Diverse aanbieders van grote taalmodellen introduceerden hun eigen methodes om externe systemen aan te spreken. Zo kwam OpenAI in 2023 met een function calling API (Application Programming Interface) en bracht het ook plug-ins voor ChatGPT uit. Maar elke aanbieder vond het wiel opnieuw uit. Tot Anthropic, het bedrijf achter het groot taalmodel Claude, in november 2024 het Model Context Protocol presenteerde als een open standaard en framework voor de integratie van grote taalmodellen met externe tools.

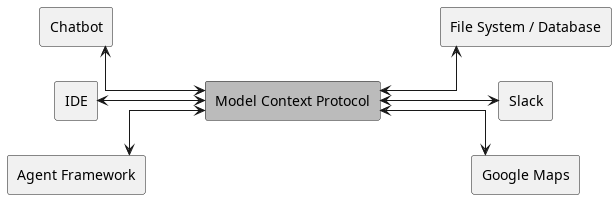

In korte tijd werd MCP dé standaard, en in maart 2025 werd ze zelfs door OpenAI geïntegreerd in ChatGPT en later ook in de Gemini-modellen van Google. Daardoor was het niet langer nodig om voor elke combinatie van tool en taalmodel een nieuwe integratie te creëren. Dat bracht de ontwikkeling van AI-agents, autonoom handelende programma’s, in een stroomversnelling. Het bood AI-agents immers één gestandaardiseerde manier om tools, services en data te gebruiken. Ze kunnen aanvragen naar elke MCP-compatibele tool sturen en de resultaten daarvan verkrijgen.

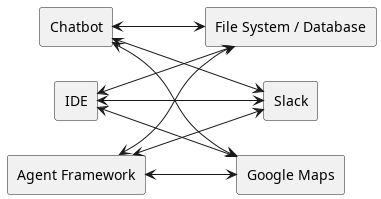

Zonder een standaardinterface moet elke agent een integratie met elke tool of databron hebben

Het Model Context Protocol dient als standaardinterface tussen AI-agents en tools of databronnen

Architectuur

Binnen de architectuur van MCP wordt een agent aangeduid als een MCP Host. Dat kan een desktopapplicatie voor een groot taalmodel zoals Claude of ChatGPT zijn, maar ook een ontwikkelomgeving met een taalmodel om code te genereren, of gelijk welke andere software die als AI-agent functioneert. Aan de andere kant bevinden zich databronnen, lokale tools en online services met een API.

De rest van dit artikel is alleen beschikbaar voor HCC-leden. Ben je HCC-lid? Om het gehele artikel te lezen dien je ingelogd te zijn. Nog geen HCC-lid? Word nu lid en kies je welkomstgeschenk!